當你在 ChatGPT 問「推薦台北咖啡廳」,它是從哪裡得到答案的?

答案是:AI 爬蟲。

就像 Google 用 Googlebot 爬取網站一樣,OpenAI、Anthropic、Perplexity 等公司也有自己的爬蟲程式,專門抓取網站內容供 AI 使用。

問題是:你的網站設定正確了嗎? AI 爬蟲能順利訪問並理解你的內容嗎?

本文將帶你認識各家 AI 爬蟲、了解如何在 robots.txt 進行設定,以及該採取什麼策略來最大化你的 AI 可見度。

💡 想讓 AI 搜尋引擎找到你的網站?

AI 爬蟲設定只是 GEO 的第一步,讓專家幫你評估完整的 AI 可見度優化策略。

AI 爬蟲是什麼?與傳統搜尋引擎爬蟲的差異

在深入設定細節之前,讓我們先搞清楚 AI 爬蟲和傳統爬蟲有什麼不同。

如果你想了解更多 GEO(生成式引擎優化) 的基本概念,可以先閱讀核心指南。

傳統爬蟲(Googlebot)的運作方式

你應該已經對 Google 的爬蟲機制不陌生:

- Googlebot 爬取網頁:發現並讀取網站內容

- 建立搜尋索引:將內容存入 Google 資料庫

- 根據演算法排名:決定搜尋結果的排序

- 使用者搜尋時呈現:顯示相關的搜尋結果

這套系統已經運作超過 20 年,規則成熟、行為可預測。

AI 爬蟲的特性

AI 爬蟲的運作邏輯和目的都不太一樣:

| 特性 | 說明 |

|---|---|

| 主要目的 | 訓練 AI 模型,或用於即時搜尋回答 |

| 使用方式 | 內容被 AI 理解後,用於生成回答 |

| 抓取邏輯 | 不是為了排名,而是為了理解內容 |

| 行為模式 | 較新,規則仍在發展中 |

簡單說,傳統爬蟲關心的是「這個頁面該排第幾名」,而 AI 爬蟲關心的是「這個內容說了什麼」。

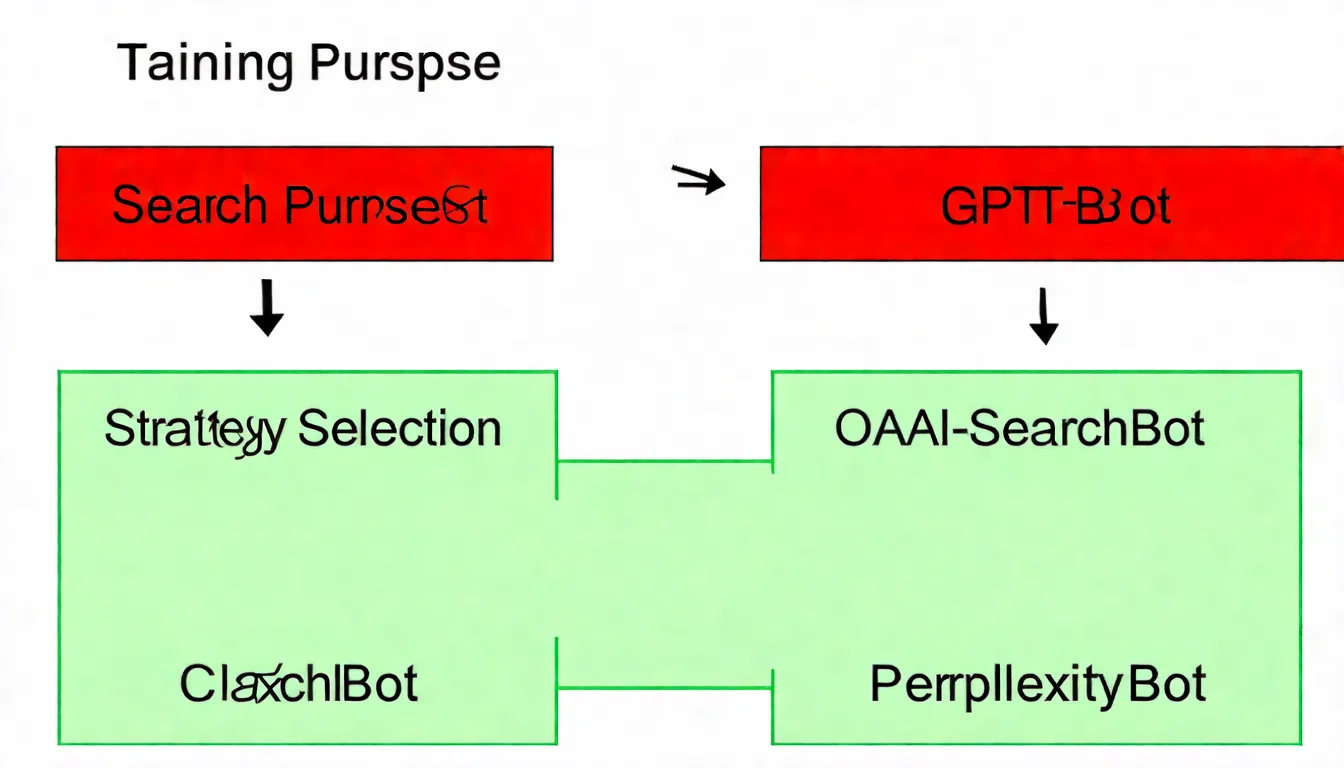

兩種用途的 AI 爬蟲

AI 爬蟲大致可分為兩類:

- 訓練用途爬蟲:抓取內容用來訓練 AI 模型

- 搜尋用途爬蟲:抓取內容用於即時回答問題

這個區分很重要,因為你可能想允許「搜尋用途」的爬蟲(增加曝光),但封鎖「訓練用途」的爬蟲(保護內容)。

主流 AI 爬蟲一覽

目前市場上的 AI 工具百家爭鳴,它們各自有不同的爬蟲。讓我們逐一認識。

OpenAI 系列

OpenAI 是 ChatGPT 的開發公司,擁有多個不同用途的爬蟲:

| 爬蟲名稱 | User-Agent 識別 | 主要用途 |

|---|---|---|

| GPTBot | GPTBot |

用於訓練 GPT 模型 |

| OAI-SearchBot | OAI-SearchBot |

ChatGPT 即時搜尋功能 |

| ChatGPT-User | ChatGPT-User |

ChatGPT 網頁瀏覽功能 |

關鍵區分:

- GPTBot:你的內容會被用來「訓練」AI 模型

- OAI-SearchBot:你的內容會被用來「即時回答」用戶問題

如果你希望 ChatGPT 在回答問題時引用你的網站,需要允許 OAI-SearchBot。

Anthropic 系列

Anthropic 是 Claude 的開發公司:

| 爬蟲名稱 | User-Agent 識別 | 主要用途 |

|---|---|---|

| ClaudeBot | ClaudeBot |

用於訓練 Claude 模型 |

| Claude-SearchBot | Claude-SearchBot |

Claude 即時搜尋功能 |

目前狀態:Anthropic 的搜尋爬蟲較 OpenAI 晚推出,規則仍在持續更新中。

其他 AI 爬蟲

除了 OpenAI 和 Anthropic,還有其他重要的 AI 爬蟲:

| 爬蟲名稱 | 所屬公司 | 主要用途 |

|---|---|---|

| PerplexityBot | Perplexity AI | 專注搜尋的 AI 引擎 |

| GoogleOther | Google 的 AI 相關用途 | |

| Bytespider | 字節跳動 | TikTok 母公司的 AI 爬蟲 |

| Meta-ExternalAgent | Meta | Facebook/Instagram 母公司 |

| cohere-ai | Cohere | 企業 AI 解決方案 |

完整 AI 爬蟲對照表

以下是目前主流 AI 爬蟲的完整列表:

| 爬蟲名稱 | 所屬公司 | 用途分類 | 建議處理 |

|---|---|---|---|

| GPTBot | OpenAI | 訓練 | 視需求封鎖 |

| OAI-SearchBot | OpenAI | 搜尋 | 建議允許 |

| ChatGPT-User | OpenAI | 瀏覽 | 建議允許 |

| ClaudeBot | Anthropic | 訓練 | 視需求封鎖 |

| Claude-SearchBot | Anthropic | 搜尋 | 建議允許 |

| PerplexityBot | Perplexity | 搜尋 | 建議允許 |

| GoogleOther | 混合 | 視需求設定 | |

| Bytespider | 字節跳動 | 混合 | 視需求設定 |

robots.txt 中的 AI 爬蟲設定

了解各家爬蟲後,讓我們進入實際設定環節。

robots.txt 基本語法複習

robots.txt 是放在網站根目錄的純文字檔案,用來告訴爬蟲「哪些內容可以爬、哪些不行」。

基本語法:

User-agent: [爬蟲名稱]

Allow: [允許訪問的路徑]

Disallow: [禁止訪問的路徑]

舉例:

User-agent: Googlebot

Allow: /

User-agent: BadBot

Disallow: /

如何設定 AI 爬蟲

設定 AI 爬蟲的方式和一般爬蟲完全相同,差別只在 User-agent 名稱。

設定 1:允許特定 AI 爬蟲

User-agent: OAI-SearchBot

Allow: /

User-agent: Claude-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /

設定 2:封鎖特定 AI 爬蟲

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

設定 3:允許搜尋、封鎖訓練(折衷方案)

這是最常見的策略:讓 AI 可以引用你的內容,但不用於模型訓練。

User-agent: OAI-SearchBot

Allow: /

User-agent: Claude-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: ChatGPT-User

Allow: /

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

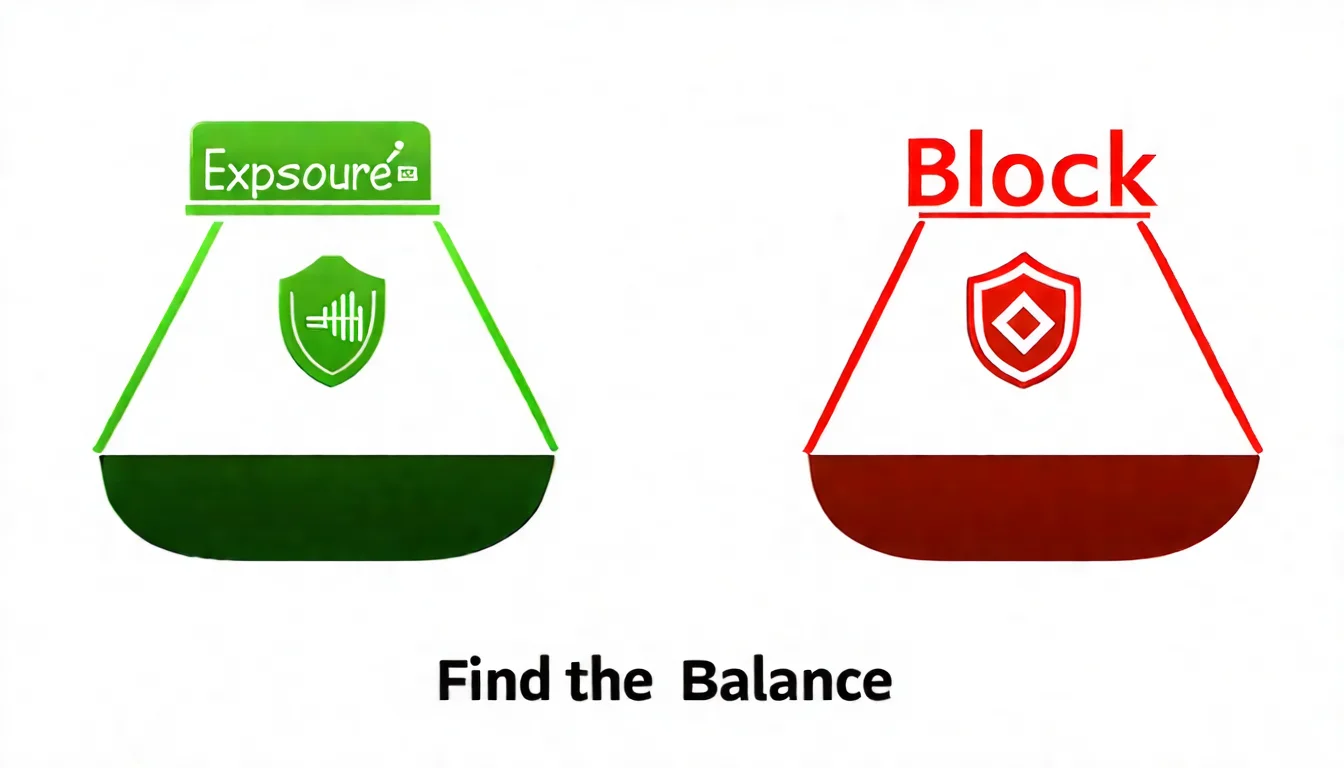

該允許還是封鎖 AI 爬蟲?策略分析

這是最多人問的問題。讓我們從不同角度分析。

允許 AI 爬蟲的優點與風險

優點:

| 好處 | 說明 |

|---|---|

| 增加曝光 | 內容可被 AI 工具引用,獲得新流量來源 |

| 搶佔先機 | 趁競爭對手還沒意識到,先建立 AI 可見度 |

| 免費推薦 | 被 AI 引用相當於獲得免費推薦 |

| 跟上趨勢 | AI 搜尋使用率持續上升 |

風險:

| 風險 | 說明 |

|---|---|

| 內容被訓練 | 如果允許訓練爬蟲,內容可能被用於 AI 模型 |

| 無法控制 | 無法控制 AI 如何呈現你的內容 |

封鎖 AI 爬蟲的優點與風險

優點:

| 好處 | 說明 |

|---|---|

| 保護內容 | 內容不會被用於 AI 訓練 |

| 控制使用 | 決定內容的使用方式 |

風險:

| 風險 | 說明 |

|---|---|

| 失去曝光 | 失去在 AI 搜尋結果中曝光的機會 |

| 落後競爭者 | 當競爭對手被 AI 引用,你卻不在 |

依網站類型的建議策略

| 網站類型 | 建議策略 | 說明 |

|---|---|---|

| 內容網站 / 部落格 | 允許所有 | 最大化曝光機會 |

| 電商網站 | 允許搜尋爬蟲 | 讓產品被 AI 推薦 |

| 企業官網 | 允許搜尋爬蟲 | 增加品牌能見度 |

| 隱私敏感網站 | 可考慮封鎖 | 保護敏感內容 |

| 付費訂閱內容 | 封鎖訓練爬蟲 | 保護付費內容價值 |

我的建議

對大多數網站來說,我建議採取折衷策略:

- ✅ 允許搜尋用途爬蟲(OAI-SearchBot、Claude-SearchBot、PerplexityBot)

- ⚠️ 考慮封鎖訓練用途爬蟲(GPTBot、ClaudeBot)

這樣你既能享受 AI 搜尋曝光的好處,又能保護內容不被用於模型訓練。

想了解更多策略規劃,可以參考 台灣企業 GEO 策略 這篇文章。

💡 不確定該怎麼設定?

每個網站的情況不同,讓專家幫你分析最適合的策略。

實作教學:完整設定範例

理論講完了,讓我們看看實際的完整設定範例。

範例 1:最大化 AI 曝光(允許所有爬蟲)

適合:內容網站、部落格、希望最大曝光

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

User-agent: GPTBot

Allow: /

User-agent: OAI-SearchBot

Allow: /

User-agent: ChatGPT-User

Allow: /

User-agent: ClaudeBot

Allow: /

User-agent: Claude-SearchBot

Allow: /

User-agent: PerplexityBot

Allow: /

User-agent: GoogleOther

Allow: /

User-agent: *

Allow: /

Sitemap: https://你的網域.com/sitemap.xml

範例 2:平衡策略(允許搜尋、封鎖訓練)

適合:大多數商業網站

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

User-agent: OAI-SearchBot

Allow: /

User-agent: ChatGPT-User

Allow: /

User-agent: GPTBot

Disallow: /

User-agent: Claude-SearchBot

Allow: /

User-agent: ClaudeBot

Disallow: /

User-agent: PerplexityBot

Allow: /

User-agent: *

Allow: /

Sitemap: https://你的網域.com/sitemap.xml

範例 3:保守策略(封鎖大部分 AI 爬蟲)

適合:有隱私顧慮或付費內容的網站

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: Bytespider

Disallow: /

User-agent: cohere-ai

Disallow: /

User-agent: OAI-SearchBot

Allow: /public/

Disallow: /members/

Disallow: /premium/

User-agent: *

Disallow: /members/

Disallow: /premium/

Sitemap: https://你的網域.com/sitemap.xml

驗證設定是否生效

設定完成後,請進行以下驗證:

步驟 1:直接檢查檔案

在瀏覽器輸入 https://你的網域.com/robots.txt,確認內容正確顯示。

步驟 2:使用測試工具

- Google Search Console 的 robots.txt 測試工具

- 線上 robots.txt 驗證工具

步驟 3:觀察伺服器日誌(進階)

如果你有存取權,可以查看伺服器日誌,觀察各爬蟲的訪問記錄。

注意事項:

- robots.txt 修改後立即生效

- 但爬蟲需要再次訪問才會讀取新設定

- 通常需要數天才能看到效果

- 無法強制爬蟲立即更新

搭配 llms.txt 使用

robots.txt 設定只解決了「AI 能不能來」的問題,但沒有解決「AI 怎麼理解你」的問題。

這就是為什麼你還需要設定 llms.txt。

| 檔案 | 功能 | 類比 |

|---|---|---|

| robots.txt | 控制訪問權限 | 門禁系統 |

| llms.txt | 提供網站說明 | 接待員 |

建議同時設定兩者:

- 在 robots.txt 設定允許 AI 爬蟲訪問

- 在 llms.txt 提供網站的完整說明

詳細的 llms.txt 設定方式,請參考 llms.txt 設定完整教學。

常見問題 FAQ

Q1:AI 爬蟲會影響網站效能嗎?

通常不會造成明顯影響。

AI 爬蟲的抓取頻率比傳統搜尋引擎爬蟲低很多。如果你發現異常流量,可以:

- 檢查伺服器日誌確認來源

- 在 robots.txt 設定 Crawl-delay(部分爬蟲支援)

- 使用 CDN 或防火牆過濾

Q2:設定後多久會生效?

robots.txt 修改後立即生效,但:

- 爬蟲需要再次訪問才會讀取新設定

- 通常需要幾天到一週

- 無法強制爬蟲立即更新

- 耐心等待即可

Q3:可以針對特定頁面或目錄設定嗎?

可以。使用路徑規則即可:

User-agent: GPTBot

Disallow: /members/

Disallow: /premium/

Allow: /public/

這樣 GPTBot 會被禁止訪問 /members/ 和 /premium/ 目錄,但可以訪問 /public/ 目錄。

Q4:如果不設定 robots.txt 會怎樣?

沒有設定 robots.txt,等同於允許所有爬蟲訪問所有內容。

這不一定是壞事,但你會失去控制權。建議至少建立基本設定。

Q5:AI 爬蟲會遵守 robots.txt 嗎?

主流 AI 公司(OpenAI、Anthropic、Perplexity 等)都會遵守 robots.txt 設定。

這是業界慣例,也是這些公司公開承諾的行為。

AI 爬蟲設定該記住什麼?完整重點整理

恭喜你讀完這篇完整攻略!讓我們快速複習:

| 重點 | 說明 |

|---|---|

| AI 爬蟲的目的 | 訓練 AI 模型,或用於即時搜尋 |

| 主要爬蟲 | OpenAI(GPTBot、OAI-SearchBot)、Anthropic(ClaudeBot、Claude-SearchBot)、PerplexityBot |

| 設定方式 | 在 robots.txt 中使用 User-agent、Allow、Disallow |

| 建議策略 | 允許搜尋爬蟲,視需求決定是否允許訓練爬蟲 |

| 搭配設定 | 同時設定 llms.txt 效果更好 |

AI 爬蟲設定只是 GEO 優化的技術基礎。真正要讓 AI 引用你的內容,還需要搭配內容策略、結構優化等綜合考量。

AI 爬蟲設定只是第一步

完整的 GEO 優化需要技術設定加上內容策略的配合。讓專家幫你規劃完整的 AI 可見度優化策略: